به گزارش خبرنگار علم و فناوری ایسکانیوز؛ کاربران عروسکی در سراسر ایکس و فیدهای فیسبوک، اینستاگرام و حتی تیک تاک دیده میشوند. در این شبکههای اجتماعی یا عکسهای انیمیشنی را میبینید یا آموزش ساخت آنها را. حتی عروسکهایی در سراسر لینکدین وجود دارد که میتوان گفت جدیترین و کم سرگرمکنندهترین عضو باند شبکههای اجتماعی است.

می توانید آن را درمان هوش مصنوعی باربی یا ترند جعبه باربی بنامید. یا اگر باربی مورد علاقه شما نیست، میتوانید با اکشن فیگورهای هوش مصنوعی، بسته آغازین اکشن فیگور یا گرایش اکشن فیگورهای ChatGPT بروید. این اکشن فیگورها نه تنها شامل جعبه و بستهبندی و عروسکی شبیه به باربی میشود، بلکه میتواند لوازم جانبی هم به هرماه داشته باشد.

در این ترند جدید، مردم از ابزارهای هوش مصنوعی مولد مانند ChatGPT استفاده میکنند تا خود را شبیه عروسک یا اکشن فیگور و لوازم جانبی کامل تصور کنند. این ترند حتی افراد مشهور، سیاستمداران و برندهای بزرگ را نیز با خود همراه کرده است. حتی خبرنگارانی که در مورد این ترند گزارش میدهند، نسخههایی از خود را ساختهاند که میکروفون و دوربین در دست دارند. جالب است که برخی کاربران دست به ابتکار جالبی زدهاند و نسخههایی از هر چهره قابل توجه خود ساختهاند؛ از میلیاردر ایلان ماسک گرفته تا بازیگر و خواننده آریانا گرانده.

اینطور که به نظر میرسد همه در حال لذت بردن از «من پلاستیکی» خود هستند.

اما برخی از کارشنان معتقدند که روند جدید هوش مصنوعی مولد به ظاهر موضوع تفننی است، اما نگرانیهایی به همراه دارد که از میان آنها میتوان به استفاده زیاد انرژی و همچنین دادههای هوش مصنوعی اشاره کرد.

ترس از دادههای شخصی

«آناتولی گروزد»، استاد و مدیر تحقیقات آزمایشگاه رسانههای اجتماعی در دانشگاه متروپولیتن تورنتو، میگوید: وقتی صحبت از هوش مصنوعی مولد به میان میآید، هنوز هم غرب وحشی است. اکثر چارچوبهای خطمشی و قانونی به طور کامل با این نوآوری سازگار نبودهاند و این را به شرکتهای هوش مصنوعی واگذار میکنند تا تعیین کنند چگونه از دادههای شخصی که ارائه میدهید، استفاده کنند.

گروزد توصیه میکند که هنگام استفاده از این برنامههای جدید احتیاط کنید. اما اگر تصمیم به آزمایش دارید، پیشنهاد میکند به دنبال گزینهای بگردید تا از استفاده از دادههایتان برای آموزش یا سایر اهداف شخص ثالث در تنظیمات انصراف دهید.

او میگوید: اگر چنین گزینهای در دسترس نیست، ممکن است بخواهید در استفاده از برنامه تجدید نظر کنید؛ در غیر این صورت، اگر تصویر انیمیشنیتان در زمینههای غیرمنتظره مانند تبلیغات آنلاین ظاهر شود، تعجب نکنید!

مولد عروسک هوش مصنوعی چگونه کار میکند؟

ممکن است پیچیده به نظر برسد، اما فرآیند ساده است. افراد عکسی از خود را به ابزاری مانند ChatGPT آپلود میکنند و همراه با اعلانهای نوشته شده پیش میروید که توضیح میدهد که میخواهند تصویر نهایی چگونه به نظر برسد.

BBC گزارش میدهد که این دستورالعملها واقعا مهم هستند. آنها همه چیزهایی که قرار است تولید شود را به ابزار هوش مصنوعی میگویند؛ از مواردی که فرد میخواهد با آنها ظاهر شود تا قالبی که باید در آن باشد که شامل تقلید از جعبه و فونت اسباببازیهای محبوب مانند باربی است. سپس بسیاری از افراد تصویر خود را با نام، شغل و انتخاب لباس شخصیسازی میکنند. البته این دستورالعملها همیشه هم کار نمی کند؛ تا جایی که شاهد بودهایم برخی کاربران اشتباهات بارز و خندهدار این ابزارها را نیز به اشتراک گذاشتهاند. مثلا عروسکهای اکشن اصلا شباهتی به کاربر ندارد و حتی در موردی تصویر پسری که موهای فرفری و بلند دارد، به شکل یک گوسفند انیمیشنی درآمده است.

در واقع، مولدهای تصویر مانند سایر ابزارهای مولد هوش مصنوعی مستعد ساختن چیزهایی هستند و ممکن است در مورد ظاهر یک فرد فرضیاتی ایجاد کنند. و جالبتر اینکه فقط افراد عادی نیستند که از این ابزار استفاده میکنند. این روند توسط تعداد زیادی از برندهای آنلاین از جمله شرکت زیبایی «ماریو بادسکو» و حتی «رویال میل» مورد توجه قرار گرفته است.

جذابیت چیست؟

موضوعات و فرآیندهای ترند شده میآیند و میروند، اما طبیعتاً میتوانند باعث شوند که کاربران فقط برای اینکه از این موج عقب نمانند خود را در این جریان قرار میدهند و در این مورد خیلیها به دلیل جوسازی که ایجاد شده، دست به تصویرسازی انیمیشنی خود میزنند. همانطور که «جاسمین انبرگ»، تحلیلگر رسانههای اجتماعی در «ایمارکتر» میگوید: هوش مصنوعی مولد باعث میشود افراد بتوانند ترندها یا روندهای خاص را ایجاد کنند و به آنها بپیوندند.

او میگوید: این فناوری تولید محتوای آنلاین را سریعتر و آسانتر کرده است، ولی چیزی که مهم است، این است که ممکن است تأثیر غیرمنتظرهای در تسریع سرعت آزار سایر کاربران رسانههای اجتماعی داشته باشد.

او معتقد است که گرایشهای مبتنی بر هوش مصنوعی در فیدهای ما ظاهر منظمتری خواهند داشت، زیرا فناوری به بخشی منظمتر از زندگی دیجیتال ما تبدیل میشود.

نگرانیهای بزرگ چیست؟

در حالی که طبیعت جالب تصویرسازی انیمیشنی ممکن است کاربران را به سمت خود بکشاند، این روند با انتقاد و نگرانیهایی در مورد تأثیرات زیستمحیطی را برانگیخته است.

پروفسور «جینا نف» از دانشگاه کوئین مری لندن میگوید:ChatGPT روزانه مقدار بسیاری انرژی مصرف میکند و مراکز دادهای که برای تأمین انرژی آن استفاده میشوند، در سال نسبت به انرژی مصرفی ۱۱۷ کشور، برق بیشتری مصرف میکنند.

«لنس اولانوف»، سردبیر آمریکایی «تکرادار» در مقالهای در مورد این روند میگوید: ما در خانه سر این ماجرا همیشه شوخی داریم که البته شوخی تلخی است. ما میگوییم که هر بار یکی از این میمهای (الگوی رفتاری، واحد اطلاعات فرهنگی است که از طریق تقلید منتشر میشود) هوش مصنوعی که انجام میدهیم، درختی را میکشیم. البته شاید در این مورد اغراق میکنیم، به جرات میتوانم بگویم که تولید محتوای هوش مصنوعی بدون هزینه نیست و شاید باید به آن فکر کنیم و از آن به گونهای دیگر استفاده کنیم.

کارشناسان همچنین بر این نگرانی تاکید کردهاند که دادههای دارای حق چاپ ممکن است برای ایجاد فناوری تولید تصاویر بدون پرداخت هزینه استفاده شده باشد و در واقع حقوق آنها نقض شود.

نف نیز میگوید که ابزار «چتجیپیتی باربی» یک تهدید سه گانه برای حریم خصوصی، فرهنگ و سیاره ما به شمار میرود.

او میافزاید: در حالی که شخصیسازی ممکن است احساس خوبی داشته باشد، این سیستمها برندها و شخصیتها را بدون هیچ مسئولیتی در قبال ظاهر افراد درون یک مخلوطکن قرار میدهند و در واقع، حقوق آنها را نقض میکنند.

«جو برومیلو»، مدیر بخش اجتماعی و اینفلوئنسر در یک آژانس روابط عمومی، نیز این سوال را مطرح میکند که آیا یک نتیجه زیبا و خندهدار واقعا ارزشش را دارد؟

او میگوید: اگر واقعاً میخواهیم از هوش مصنوعی به درستی استفاده کنیم، باید حفاظهایی را در مورد نحوه استفاده دقیق از آن تنظیم کنیم.

مصرف برق هوش مصنوعی

مطالعهای از دانشگاه کرنل ادعا میکند که آموزش مدل زبان نسخه سوم چتجیپیتی متعلق به شرکت OpenAI در مراکز داده مایکروسافت در ایالات متحده میتواند به طور مستقیم ۷۰۰ هزار لیتر آب شیرین تمیز را تبخیر کند. گلدمن ساکس تخمین زده است که هوش مصنوعی باعث افزایش ۱۶۰ درصدی تقاضای برق مرکز داده خواهد شد.

انرژی مورد نیاز برای تولید هوش مصنوعی ردپای کربن قابل توجهی را پشت سر میگذارد، اما به طور فزایندهای به عنوان ابزاری برای اقدامات آب و هوایی استفاده میشود. براساس برخی برآوردها، میانگین Query ChatGPT حدود ۱۰ برابر بیشتر از یک جستوجوی گوگل انرژی مصرف میکند.

حتی «سام آلتمن»، مدیر عامل OpenAI، در مورد محبوبیت تولید تصاویر ابراز نگرانی کرده است و ماه گذشته در شبکه اجتماعی ایکس نوشت که باید به طور موقت محدودیتهایی را در حالی که برای کارآمدتر کردن آن کار میکرد، اعمال میکرد، زیرا واحدهای پردازش گرافیکی آن در حال ذوب شدن بودند.

در همین حال، همانطور که عروسکهای تولید شده توسط هوش مصنوعی فید رسانههای اجتماعی ما را اشغال میکنند، نسخهای نیز توسط هنرمندانی که نگران کاهش ارزش آثارشان هستند، با استفاده از هشتگ #StarterPackNoAI منتشر میشود.

قبلاً نگرانیهایی در مورد آخرین روند هوش مصنوعی مطرح شده بود، جایی که کاربران تصاویری از خود را به سبک استودیوی انیمیشن توکیو استودیو گیبلی تولید میکردند - و بحثی را در مورد اینکه آیا این کار آثار هنرمندان انسانی را میدزدید به راه انداخت.

با وجود نگرانیها، برخی میگویند که این نوع روندها مثبت هستند، اما برای شرکتهای هوش مصنوعی که تلاش میکنند پایگاه کاربران خود را رشد دهند. آموزش و ادامه کار این مدلها بسیار گران است، اما اگر افراد کافی از آنها استفاده کنند و به آنها وابسته شوند، شرکتها میتوانند قیمت اشتراک خود را افزایش دهند. به همین دلیل است که این نوع روندها برای این شرکتهایی که عمیقاً در قرمز هستند بسیار خوب است.

تست روند عروسک هوش مصنوعی

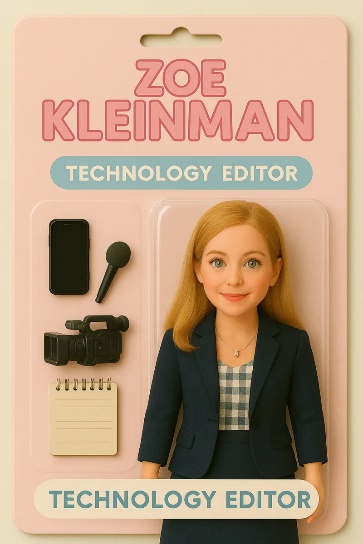

ترند ساخت تصویر عروسکی هوش مصنوعی باعث شد که یکی از ادیتورهای BBC به فکر تست این روند بپردازد.

«زوئی کلینمن» میگوید: با یافتن یک درخواست پیشنهادی به صورت آنلاین شروع به تصویرسازی انیمیشنی کردم و با لیستی از دستورالعملها برای وارد کردن ابزار هوش مصنوعی به منظور تولید تصویر مواجه شدم.

متوجه شدم که شما باید سلفی خود را آپلود کنید و همچنین باید در مورد جزئیات آن از جمله فهرستی از لوازم جانبی که میخواهید گنجانده شود و رنگ جعبه وقت بگذارید. خودم متوجه شدم که برای کامل کردن یک نسخه جیبی و بستهبندی پلاستیکی کلی زمان از من گرفته شد.

وقتی نوبت به ارائه عنوان شغلی رسید، اولین تلاش من رد شد، زیرا اخبار بیبیسی را اضافه کردم و از طرف چتجیپیتی با محتوای «نقض حریم خصوصی» مواجه شدم. فکر میکنم چون در حال حاضر بیبیسی به ChatGPT اجازه استفاده از خروجی خود را نمیدهد، این اتفاق رخ داد.

هنگامی که یک تصویر از این ابزار دریافت میکنید، احتمالاً میخواهید آن را بیشتر تغییر دهید. چون اولین تلاش من بیش از حد کارتونی بود و اصلا شبیه خودم نبود. نسخه واقعیتر نیز باعث شد که من به طور قابلتوجهی بزرگتر از سن خودم به نظر برسم، و در نسخه دیگر، خیلی شبیه بچهها به نظر میآمدم، و در پایان از تلاش برای استفاده از رنگ چشم واقعیام، که به طور پیشفرض به آبی تبدیل میشد، دست کشیدم.

چند دقیقه طول کشید تا هر نسخه تولید شود و به طور بالقوه به دلیل محبوبیت آن، روند کندتر از آنچه من دوست داشتم انجام شد.

بعد با خودم گفتم که هماکنون برخی از سرورهای کامپیوتری داغ شدهاند، چون در حال تلاشند تا یک فیگور اکشن با صورت خودم بسازند. در حالی که آنها به طور قطع میتوانستند روی اهداف ارزشمندتری کار کنند.

انتهای پیام/

نظر شما